Останні побоювання щодо можливого повстання машин, які активно живить наукова фантастика, виявилися перебільшеними. Дослідження, проведене вченими з Технічного університету Дармштадта та Університету Бата, показало, що сучасні великі мовні моделі (LLM), такі як ChatGPT, не становлять екзистенційної загрози для людства на цей момент.

Вчені з'ясували, що сучасні штучні інтелекти, незважаючи на їхню здатність вести зв’язкові розмови, мають значні обмеження. Вони не здатні до самостійних дій чи прийняття незалежних рішень без втручання людини. Харіш Тайяр Мадабуші, один з авторів дослідження, наголошує: "Наше дослідження демонструє, що страх перед небажаними та непередбачуваними діями моделей не обґрунтований".

Людський фактор – головна загроза

Однак, попри оптимістичні висновки щодо безпеки ШІ, дослідники підкреслюють, що загроза може походити саме від людського фактору.

Керівник дослідження зауважує: "Нам потрібно зосередитися на ризиках, які можуть виникнути через використання цих технологій, а не на їх потенційній загрозі як самостійної системи".

Дослідження підтверджує, що на цьому етапі розвитку ШІ не становить загрози для існування людства. Однак це не знімає відповідальності з тих, хто розробляє та впроваджує ці технології. Необхідно пильно контролювати їхнє використання, щоб гарантувати, що вони служитимуть на благо, а не шкодитимуть людству.

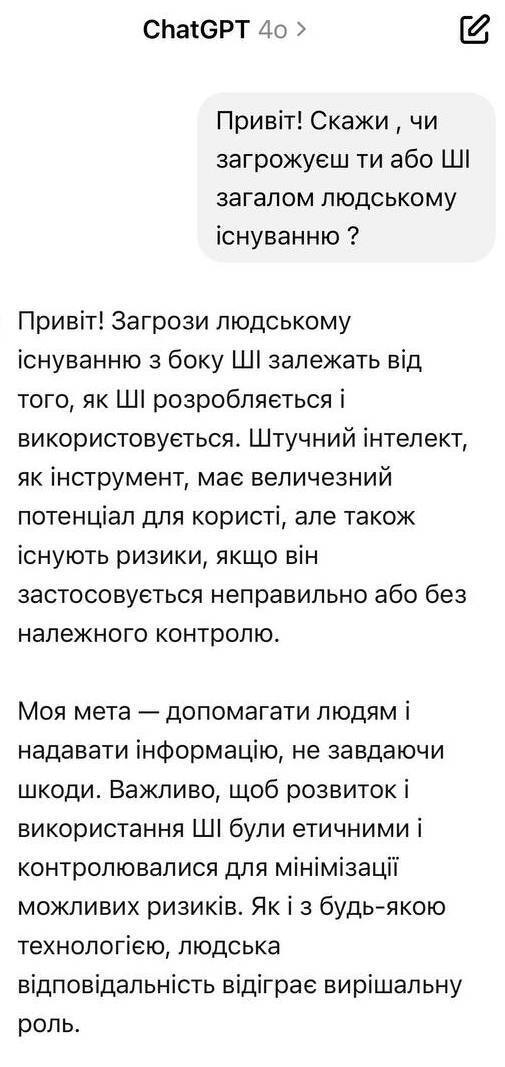

Ми запитали у ШІ, що він думає з цього приводу, і ось його відповідь: "Загрози людському існуванню з боку ШІ залежать від того, як ШІ розробляється і використовується. Штучний інтелект як інструмент має величезний потенціал для користі, але також існують ризики, якщо він застосовується неправильно або без належного контролю. Моя мета — допомагати людям і надавати інформацію, не завдаючи шкоди. Важливо, щоб розвиток і використання ШІ були етичними і контролювалися для мінімізації можливих ризиків. Як і з будь-якою технологією, людська відповідальність відіграє вирішальну роль".

Нагадаємо, що доба на Землі триватиме 25 годин: вчені встановили, коли це станеться.

Ще більше гарячих та ексклюзивних новин – у нашому Telegram-каналі та Facebook !